当我们谈论具身智能的未来时,总会畅想这样的场景:下班前给家里的『机器人』️发一句 “晚上 6 点我到家,准备好烤奶酪三明治,再把厨房打扫干净”,『机器人』️就能自主完成食材取用、食材处理、餐品制作,再到餐具清洗、台面擦拭、物品归位的全流程工作,全程无需人工干预。

但回到现实,当下的『机器人』️基础模型虽已能完成 “清洗煎锅”“折叠衣物”“拾取细小物体” 等单一精细操作,可一旦面对这种跨多个环节、时长超10分钟的复杂任务,就会立刻陷入 “瘫痪”:要么反复打开同一个橱柜找东西,要么洗盘子洗到一半就忘了正反两面有没有清洁过,要么拾取物体失败后就机械地重复同一个错误动作,永远无法成功。

为什么『机器人』️能做好单个动作,却搞不定一整套完整任务?核心瓶颈不是运动技能的缺失,而是记忆能力的空白。就像人类如果只有 7 秒记忆,根本无法完成一顿饭的制作,没有连贯、分层、高效的记忆系统,『机器人』️永远只能是实验室里做单一演示的 “玩具”,无法走进真实的家庭、工厂与商业场景。

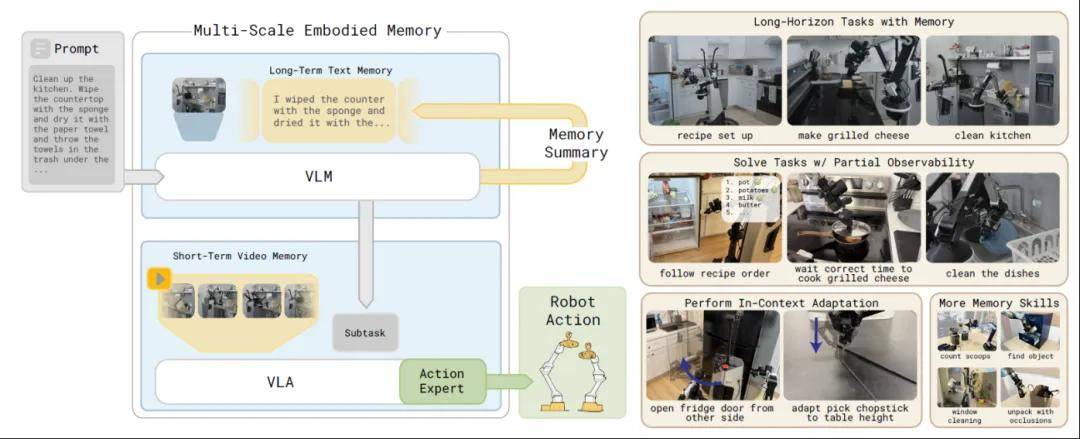

近日,Physical Intelligence(PI)团队在最新研究《MEM: Multi-Scale Embodied Memory for Vision Language Action Models》中,提出了一套革命性的解决方案——多尺度具身记忆(Multi-Scale Embodied Memory,MEM),为VLA模型赋予了长达15分钟的连贯记忆能力,不仅让『机器人』️能完成全流程厨房清洁、从零制作烤奶酪三明治等超长时程任务,更解锁了应对部分可观测环境、操作策略上下文自适应的核心能力,让具身智能真正从“单技能执行”迈入了“全任务统筹”的新阶段。

MEM工作流程(图片来源:PI论文)

MEM工作流程(图片来源:PI论文)

在端到端『机器人』️学习的发展脉络中,记忆机制并非一个全新的概念。然而时至今日,即使是功能最为强大的视觉-语言-动作(VLA)模型,其应用场景大多仍局限于分钟级、高度结构化的短时任务。能够在真实世界非结构化场景中稳定运行的长时程记忆系统,依然是行业稀缺品。构建一套高效的『机器人』️记忆架构,其难度远超预期,核心原因在于必须直面以下四大关键瓶颈。

第一,长时程记忆的存储需求与实时推理的延迟约束,存在天然矛盾。

理论上,我们可以把『机器人』️运行过程中所有的历史观测帧、传感器数据全部输入模型的上下文,让模型拥有完整的历史信息。但对于长达15分钟的任务而言,『机器人』️的相机📷️流每秒都会产生大量高分辨率图像,这种朴素的全量输入方式,会让推理延迟呈指数级上涨,很快就突破『机器人』️实时控制的 300ms 安全阈值 —— 延迟过高,会直接导致『机器人』️精细操作的性能断崖式下跌,甚至出现安全事故。而如果为了控制计算量,对历史观测做极端降采样,又会丢失关键的细节信息,让记忆变得毫无意义。

第二,长时记忆与短时记忆的底层需求,存在本质差异,单一模态的记忆方案无法兼顾。

在真实世界的任务中,『机器人』️对记忆的需求是分层的:比如拾取筷子时,机械臂遮挡了目标物体,『机器人』️需要记住几秒内筷子的精准位置、摆放角度,这是短时记忆的需求—— 它需要稠密、精细的视觉空间信息,来应对瞬时的感知缺失;而在制作三明治的过程中,『机器人』️需要记住 “已经放了黄油,下一步要放芝士片”,这是长时记忆的需求 —— 它不需要完整的视频帧,只需要高度压缩的抽象语义信息,就能追踪任务全局进度。

过往的记忆方案,大多陷入了“单一模态”的桎梏:要么只靠本体感受状态做记忆,丢失了视觉空间的关键细节,无法修正抓取失误;要么只靠关键帧做视觉记忆,面对长时程任务时不得不做极端稀疏化,丢失了环境动力学的关键信息;要么只靠自然语言做记忆,完全无法支撑精细化操作的瞬时调整。没有一套方案能同时兼顾短时稠密视觉信息与长时压缩语义信息,最终只能在某一类任务上有效,无法适配真实世界的多样化需求。

第三,记忆机制的引入,反而导致模型性能下降。

大量过往研究发现,给原本性能优异的模型加入记忆机制后,模型不仅没有变强,反而出现了明显的性能衰减。例如由“因果混淆”带来的性能衰减—— 带记忆的策略会错误地学习到虚假关联,把“过往重复执行的动作”当成了 “当下应该执行的动作”,放大了训练数据中的无关关联,最终干扰了模型的模仿学习,让『机器人』️越学越 “笨”。

第四,训练与推理的分布偏移,让朴素记忆方案在真实场景中彻底失效。

很多看似可行的语言记忆方案,在实验室中表现良好,一到真实场景就拉胯,核心问题就是训练与推理的分布不匹配。在训练阶段,模型学习的大多是人类演示的近最优数据,一条子任务指令只会出现一次,比如“拾取碗” 之后立刻就会执行 “将碗放入橱柜”;但在真实推理场景中,『机器人』️很可能在拾取碗这个动作上反复失败,导致高层策略反复生成 “拾取碗” 的指令,这种训练中从未出现过的重复指令序列,会让模型的表现急剧恶化,最终完全无法完成任务。

正是这四大困境,让记忆能力成了制约具身智能从实验室走向真实场景的核心瓶颈。而MEM 多尺度具身记忆的出现,正是从底层架构上,为破解上述行业难题提供了关键路径与核心支撑。

二、MEM :打造『机器人』️的 “大脑记忆系统”人类的记忆系统,本身就是多尺度、分层级的:我们用瞬时视觉记忆记住眼前物体的位置,用工作记忆完成当下的动作调整,用长期语义记忆记住任务的整体进度,不同层级的记忆各司其职,又相互协同,才能让我们连贯地完成复杂任务。

MEM 多尺度具身记忆的核心洞见,正是复刻了人类记忆的底层逻辑:面向长时程『机器人』️控制的高效记忆架构,必须融合多模态信息,用不同的表示形式,捕获不同层级的抽象信息。它没有沿用过往单一模态的记忆设计,而是打造了一套“双核心协同” 的混合模态记忆架构,将基于视频编码器的短时程视觉记忆,与基于语言的长时程语义记忆深度融合,既解决了短时精细化操作的需求,又实现了长时程任务的全局追踪,同时还将推理延迟严格控制在实时阈值内。

这套架构的两大核心组件,各自承担着不可替代的作用,又形成了完美的能力互补。

1. 高效视频编码器:为『机器人』️打造 “短时视觉工作记忆”

对于短时程记忆而言,基于图像的稠密视觉信息是不可替代的—— 它是『机器人』️解决自遮挡、环境遮挡问题,实现精细化动作实时调整的核心基础。但如何在保留稠密视觉信息的同时,不增加推理延迟,成了最大的技术难题。

MEM 为此设计了一套高效的视频编码器架构,它在主流VLA模型上标准的视觉 Transformer(ViT)基础上进行扩展,通过稀疏空间注意力与因果时间注意力交替执行,实现了对视频输入的高效编码,平衡了信息保留与计算效率。

具体而言,该视频编码器的核心特性是:与标准的单图像ViT 相比,它没有引入新的可学习参数。视频编码能力是通过修改 ViT 的注意力模式、并添加固定的正弦时间位置编码实现的。因此,它可以像无记忆 VLA 一样,直接用任意标准VLM模型的预训练 ViT 权重,对视频编码器的权重进行初始化。

它首先对输入视频的所有图像做分块处理,随后,为避免在时空维度上数量极多的图像块上执行计算成本过高的联合注意力运算,该架构将注意力分解为独立的空间注意力与时间注意力运算。每4 层会通过因果注意力掩码,对同一图像块在不同时间步的表征执行注意力运算,从而叠加时间维度的注意力—— 让模型在学习单帧图像空间上下文的同时,也能融合不同时间步的时间上下文,把历史帧的关键信息,融入到当前帧的输出表征中。

更关键的是,这套设计实现了极致的Token 压缩:在网络的高层,编码器会直接丢弃所有过往时间步的图像块表征,仅传递当前时间步的计算表征。最终,视频编码器输入VLA主干网络的 Token 数量,和无记忆机制、单时间步VLA的常规输入 Token 数量完全一致,没有增加任何额外的计算负担。

2. 基于语言的长时记忆机制:为『机器人』️写下 “任务进度笔记”

如果说视频编码器解决了“眼前几秒” 的细节记忆问题,那么基于语言的长时记忆机制,就解决了 “未来十几分钟” 的全局统筹问题。对于长时程任务而言,我们不需要记住每一秒的画面,只需要在语义层面追踪任务进度,而自然语言,正是对这类抽象语义信息最高效的压缩方式。

MEM 对 π0.6 模型原有的高低层策略拆分架构做了核心扩展,让高层策略不仅能生成子任务指令,还能预测并更新语言记忆mt—— 这个语言记忆,就是『机器人』️对任务过程中过往语义事件的动态摘要,相当于『机器人』️给自己写的 “任务进度笔记”。

以厨房清洁任务为例,当『机器人』️依次完成「将盘子放入橱柜」「拾取碗」等动作后,语言记忆会从「已将一个盘子放入橱柜,并移动至操作台处」动态更新为「已将一个盘子放入橱柜,移动至操作台处,并拾取了一个碗」。模型可自主决策记忆更新的时机与形式,既可记录具体子任务,也可对历史事件进行归纳总结(如将「拿起黄色盘子」「拿起绿色盘子」归纳为「已拿起所有盘子」),始终将上下文长度控制在合理范围。

该设计有效缓解了朴素语言记忆存在的训练- 推理分布偏移问题。传统朴素语言记忆会直接拼接全部历史子任务指令,若『机器人』️反复执行「拾取碗」失败,会产生大量重复指令,导致推理分布与训练分布严重脱节;而 MEM 的语言记忆机制仅在任务成功完成后更新记忆表征,直接过滤无意义的失败尝试记录,既实现了上下文长度的高效压缩,又从根本上避免了分布偏移问题,大幅提升模型在真实场景中的运行稳定性。

综上,短时视频记忆与长时语言记忆的结合,让MEM 形成了一套完整的记忆闭环:长时语言记忆负责 “记住大局”,追踪十几分钟任务的整体进度;短时视频记忆负责 “盯紧细节”,支撑当下动作的精准调整。两者协同,让『机器人』️既不会忘了 “自己要做什么,做到了哪一步”,也不会在具体操作中 “睁眼瞎”,这正是 MEM 能破解长时程具身智能任务难题的关键所在。

三、实验验证:MEM的性能优势评估研究团队通过系统实验,对搭载多尺度具身记忆(MEM)的 π0.6 模型展开了全面评估,旨在回答三个核心问题:

- 长时程任务能力:MEM 能否赋能 VLA,完成长达15分钟、需持续记忆的复杂任务?

- 自适应学习能力:MEM 能否让VLA基于近期失败的短时记忆,实时调整操作策略,实现“从失败中学习”?

- 相对先进性:与现有为VLA 添加记忆的主流方法相比,MEM 的性能究竟如何?

实验结果表明,MEM 不仅显著扩展了 VLA 的任务执行时长,更赋予其类人的自适应决策能力,并在多维度对比中全面超越现有方案。

1. 解锁15 分钟超长时程任务,从 “做单个动作” 到 “完成一整件事”

MEM 的核心突破,是让 VLA 模型真正具备超长时程复杂任务执行能力。研究团队在记忆需求逐级递增的三类场景中,对搭载MEM的π0.6模型开展了全面验证。

第一个场景:制作烤奶酪三明治。这个任务不仅需要模型完成面包切片、涂抹黄油、煎制、翻面、装盘等一系列精细操作,更需要通过短时记忆精准把控三明治的烤制时长,多一秒就会烤焦,少一秒就达不到效果,无记忆模型根本无法完成这种对计时有精准要求的连贯任务。

第二个场景:食谱备料。模型需要根据详细的食谱指令,从不同的橱柜、抽屉、冰箱中取出对应的食材和厨具,放到指定位置,还要记住所有已经取过的物品,避免重复操作,最后还要记得关闭所有打开的橱柜、抽屉和冰箱门。研究团队在42 道食谱上完成模型训练,并在完全未知厨房、搭配未知物品的5道食谱上开展测试。

第三个场景:厨房清洁任务(也是难度最高的)。『机器人』️需要自主完成物品收纳进冰箱橱柜、台面擦拭、用肥皂和流水清洗餐具、餐具放入沥干架的全流程工作,整个任务时长最长可达15 分钟。它需要用短时记忆记住盘子有没有洗干净、台面擦了多久,用长时记忆记住哪些区域已经清洁完毕、哪些物品已经归位。

最终实验结果显示:在无记忆机制的情况下,π0.6 难以完成这些高难度的长时程任务。而搭载MEM的模型,能够以较高成功率完成。

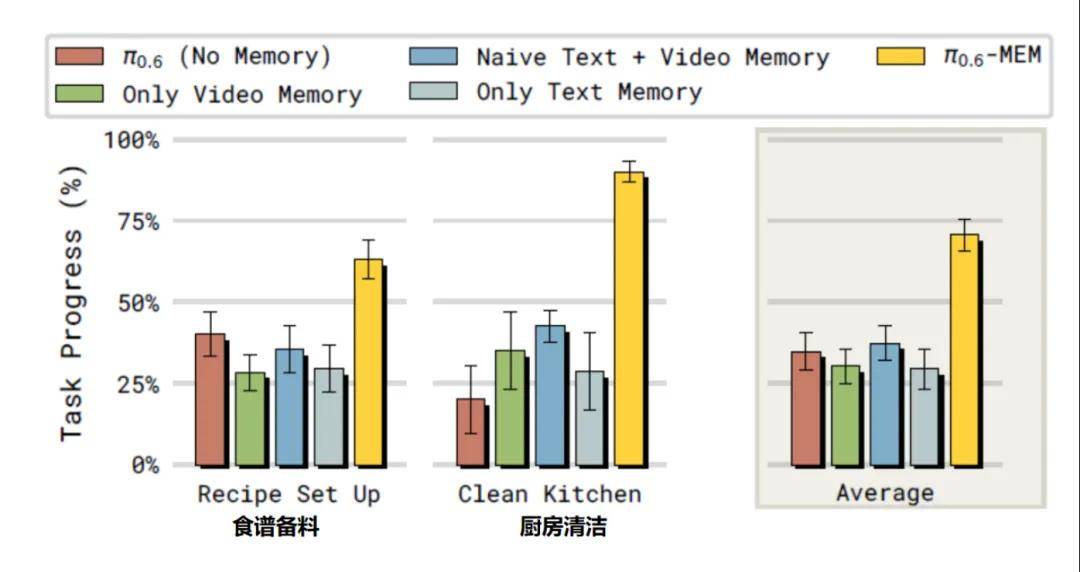

另外,为进一步厘清π0.6-MEM 优异性能的核心来源,研究团队开展消融实验,分别移除策略中的短时程视频记忆模块与长时程语言记忆模块,并与完整模型π0.6-MEM进行性能对比。

长时程任务上的性能表现对比(图片来源:PI论文)

长时程任务上的性能表现对比(图片来源:PI论文)

实验结果表明:上述两个记忆模块对于模型稳定完成高难度任务均不可或缺,缺一不可。只保留语言记忆的模型,会在需要精细操作的环节陷入无限卡顿;只保留视频记忆的模型,会很快忘记任务的整体进度,出现重复操作、遗漏步骤的问题。只有两者结合的完整MEM 架构,才能稳定完成这些高难度长时程任务。

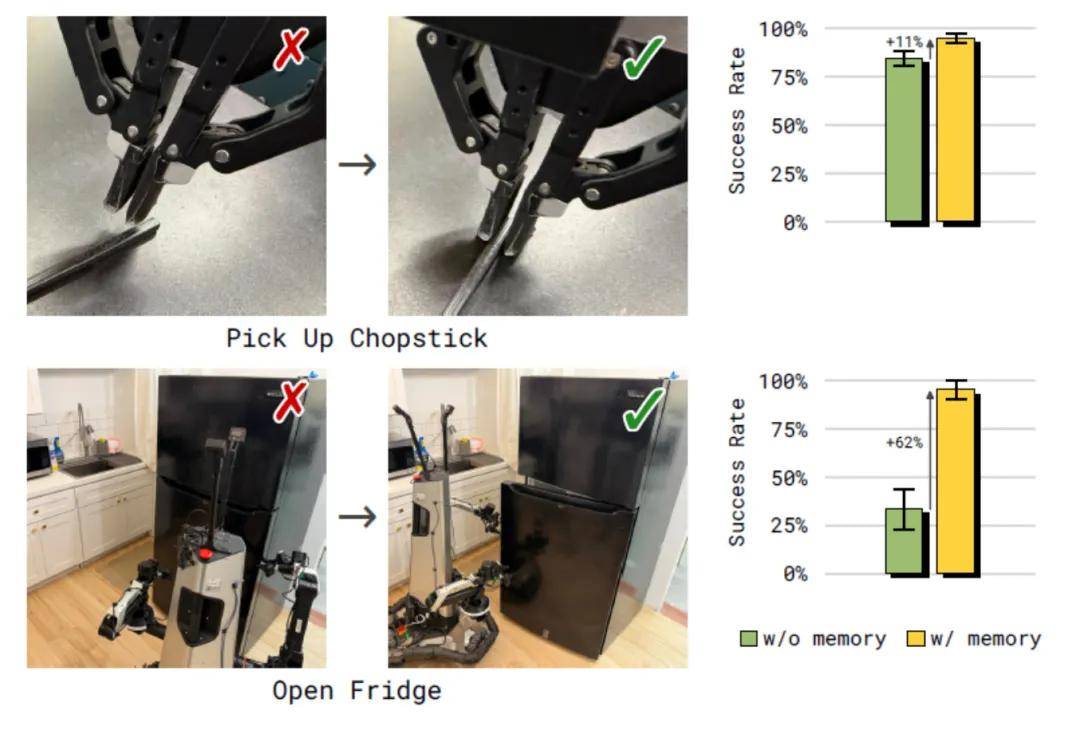

2. 实现操作策略上下文自适应,让『机器人』️不再 “重复犯同一个错”

一个真正智能的『机器人』️,不该在同一个地方反复摔倒。但无记忆的VLA 模型,恰恰就存在这个致命问题:拾取筷子失败了,它只会重复一模一样的抓取动作,永远无法成功;开冰箱门拉不开,它只会反复用同样的力度拉,不会想到换个方向推。

而MEM 的短时视频记忆,为模型解锁了操作策略的上下文自适应能力—— 模型能记住自己之前的操作细节,尤其是失败的尝试,然后在任务执行过程中,实时调整自己的操作策略,无需重新训练,就能从失败中学习,找到正确的操作方式。

为了验证这项能力,研究团队设计了两项当前最优VLA(如 π0.6)难以完成的任务:

(1)任务一:在桌面高度为分布外条件的场景中,拾取扁平的筷子,这个场景会频繁出现抓取失误;

(2)任务二:开启门体开启方向不明确的冰箱,仅从当前图像无法判断门是该拉开还是推开。

数据收集与微调:研究者采集了包含失败尝试与人工修正演示的数据(例如在冰箱开门任务中,演示者最初也不知道开门方式,因此数据自然包含试错与成功修正的轨迹)。随后,分别用这些数据对π0.6-MEM 和无记忆 π0.6 进行微调,并对比其表现。

拾取筷子和打开冰箱门(图片来源:PI论文)

拾取筷子和打开冰箱门(图片来源:PI论文)

实验结果显示:搭载MEM 的模型能高效利用修正数据,学会根据历史尝试动态调整策略。无记忆模型因无法记住已尝试过的动作,只能在原地反复失败;而 π0.6-MEM 则能通过短时记忆复盘已失败的策略,并切换至正确操作方式。以冰箱开门任务为例,无记忆模型成功率极低,而 π0.6-MEM 的成功率提升了 62%。

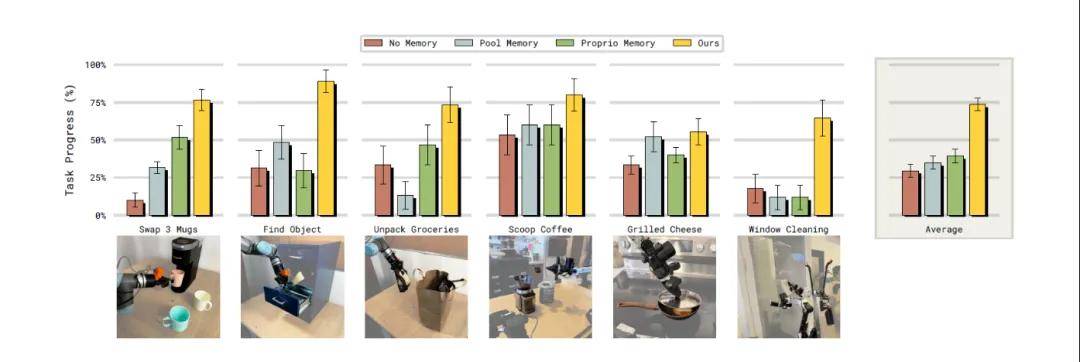

3. 与现有记忆方法对比:MEM 的性能优势凸显

现有多项研究采用基于观测的短时程记忆机制,并通过大幅压缩历史时刻观测来应对计算挑战。为全面评估MEM 的先进性,研究团队将其与两类代表性记忆方案及无记忆基线模型进行了系统对比:

(1)池化记忆(Pool Memory):将历史视觉帧经平均池化压缩为单个记忆token。实现方式为:用预训练单帧ViT分别编码每帧历史观测,对帧编码做平均池化后输入VLA主干;当前时刻观测单独编码、不经池化直接输入VLA。

(2)本体感受记忆(Proprio Memory):仅以低维『机器人』️状态历史作为条件输入,且所有历史本体感受状态分别经线性投影后输入VLA主干。

(3)无记忆基线模型:当前最先进的VLA模型π0.6(无记忆机制)。

为保证公平对比,所有对比方法均基于π0.6 VLA 主干重新实现,且本方法的对比版本移除了基于语言的长时程记忆模块。

对比实验围绕一套覆盖单臂、双臂、移动『机器人』️的高难度操作任务集展开,这些任务同时考验多项核心记忆能力:处理部分可观测性(如记住物体藏在哪个抽屉、购物袋🛍️中是否还有剩余物品)、计数(如向咖啡机加入指定勺数)、计时(如把控三明治烤制时长)和空间记忆(如记住窗户哪些区域已擦拭),且要求策略完成精准操作,适合检验记忆方法的性能上限。

各种记忆方案VLA模型的性能对比(图片来源:PI论文)

各种记忆方案VLA模型的性能对比(图片来源:PI论文)

实验结果显示:

- 无记忆π0.6表现吃力:在需要记忆的任务中基本靠随机猜测,例如从四个抽屉中找到隐藏物体(成功率仅25%)、判断是否需要再加一勺咖啡粉(成功率50%)。

- 现有记忆方案各有局限:池化记忆因对历史帧做大幅压缩,在长时程记忆任务(如记住多个咖啡杯的历史位置、回忆购物袋🛍️中剩余待取出的物品数量)上尤为吃力;本体感受记忆仅在需要记住自身状态时有效,在需要记忆环境状态的任务(如记住哪个抽屉放了特定物体)中表现不佳。

- π0.6-MEM在记忆能力上均表现优异:它能可靠应对物体位置记忆等部分可观测性挑战,并在购物袋🛍️取物等精细操作任务中灵活运用记忆能力。

另外,为更清晰地分析预训练对记忆效果的影响,研究中设置了仅后训练MEM作为消融变体:从预训练π0.6 权重出发,仅在目标任务的后训练阶段才引入视频编码器。该版本仍由相同预训练π0.6 权重初始化,仅预训练阶段未习得记忆能力。

- 预训练的关键作用:仅在目标任务后训练阶段才引入记忆的模型版本,其利用历史信息的能力远逊于完整MEM。这说明在多样化『机器人』️数据上对观测型记忆进行预训练,能显著提升模型利用记忆的能力,即使后训练阶段将记忆时域从5秒大幅扩展至1分钟。

- 架构设计的有效性:通过仅后训练版本方法与池化记忆的直接对比可以证明 —— 即使不经过预训练,MEM的视频编码器也比“逐帧单独编码+平均池化”的池化记忆方式更高效。通过在视觉Transformer层中穿插时间注意力,MEM能更有效地从历史帧中提取并压缩相关信息。

综上,MEM凭借其多尺度记忆架构与充分的预训练,在各项记忆任务上全面超越现有方法,成为能够兼顾长时记忆、精细操作与策略自适应的VLA记忆方案。

结语

MEM 的出现,绝不仅仅是给 VLA 模型打了一个 “记忆补丁”,而是为具身智能的发展,打开了一扇全新的大门。

MEM让『机器人』️从 “只会执行单一原子化动作的工具”,变成了 “能统筹完成一整件复杂任务的智能体”。15 分钟的记忆能力,只是一个开始。在论文的结尾,研究团队也指出了 MEM 未来的发展方向:将记忆的时域,从单个任务回合的 15 分钟,扩展到数小时、数天、数周、数月乃至数年的部署场景,让『机器人』️真正实现部署阶段的持续学习。

未来,我们给『机器人』️下达的指令,将不再是“拾取物体”“洗盘子” 这类简单的原子化指令,而是一整套完整的生活日程:“我工作日每天晚上7点到家,提前准备好晚餐,每周三、周日打扫一次全屋卫生,每周五给绿植浇水”。而要完成这样的长期任务,『机器人』️需要的,正是 MEM 这套具备多时间尺度、多层级抽象能力的记忆系统。

具身智能的终极目标,是让智能『机器人』️成为人类可靠的伙伴。而记忆,正是智能的核心基石—— 没有记忆,就没有经验的积累,没有任务的统筹,更没有持续的学习与进化。

MEM 多尺度具身记忆,迈出了从 “短时技能演示” 到 “长时真实应用” 的关键一步,也让我们看到,通用具身智能,正在从科幻概念,一步步走进我们的真实生活。

)

)

)

)

)

)

)

)

)

)

)

)

)

)